가상 면접 사례로 배우는 대규모 시스템 설계 기초 (System Design Interview) - 저 : 알렉스 쉬, 역 : 이병준 을 읽고 정리한 글입니다.

4 장의 내용은, 다양한 시스템 입장에서의 트랙픽 처리율을 제한하는 설계에 대해서 이야기합니다.

책의 내용을 참고해서 정리하였기 때문에, 처리율 제한 장치의 자세한 구현 방법 보다는, 이것이 무엇이고 왜 사용해야하는지

처리율 제한 장치를 설계할 떄 어디에 두어야하는지, 어떤 목표를 가지고 알고리즘이 존재하는지 등에 대해서 이야기합니다.

- 처리율 제한 장치란

- 처리율 제한 장치의 위치 (클라이언트, 서버)

- 처리율 제한 알고리즘에 대해서

- 분산 서비스 환경에서 고려해야할 점

- 그 외에, 처리율 제한 시 고려해야할 것 들

[목차]

- 처리율 제한장치란

- 처리율 제한장치의 위치 설계 및 각각의 장 단점

- 처리율 제한 알고리즘

- 처리율 제한 장치 설계 시 고려야할 점 (분산 서비스, 성능 저하, 기타 등등)

📌 01. 처리율 제한 장치란

네트워크 시스템에서 처리율 제한 장치란, 클라이언트 또는 서비스가 보내는 트래픽의 처리율(rate) 을 제어하기 위한 장치이다.

여기서 트래픽이란, 인터넷상에서 송수신 되는 모든 통신의 양을 의미합니다.

API 에 트래픽(처리율) 제한 장치를 두었을 떄 장점

- DoS 공격에 의한 자원 고갈 방지

- 비용 절감

- 추가 요청에 대한 처리를 제한 → 서버를 많이 두지 않아 됨 (말 그대로, 제한이라고 생각)

- third-party API 의 불필요한 과금을 방지 → ex) 신용 조회, 결제 api 등등

- 서버 과부하 방지

- 봇에서 오는 트래픽이나 사용자의 잘못된 이용 패턴으로 유발된 트래픽을 걸러내는데 처리율 제한 장치를 활용

📌 02. 처리율 제한 장치의 설계

모든 설계의 중점은, 요구사항을 파악하고 오버 엔지니어링을 피하며, 모든 것을 수용할 시스템을 만드는 것

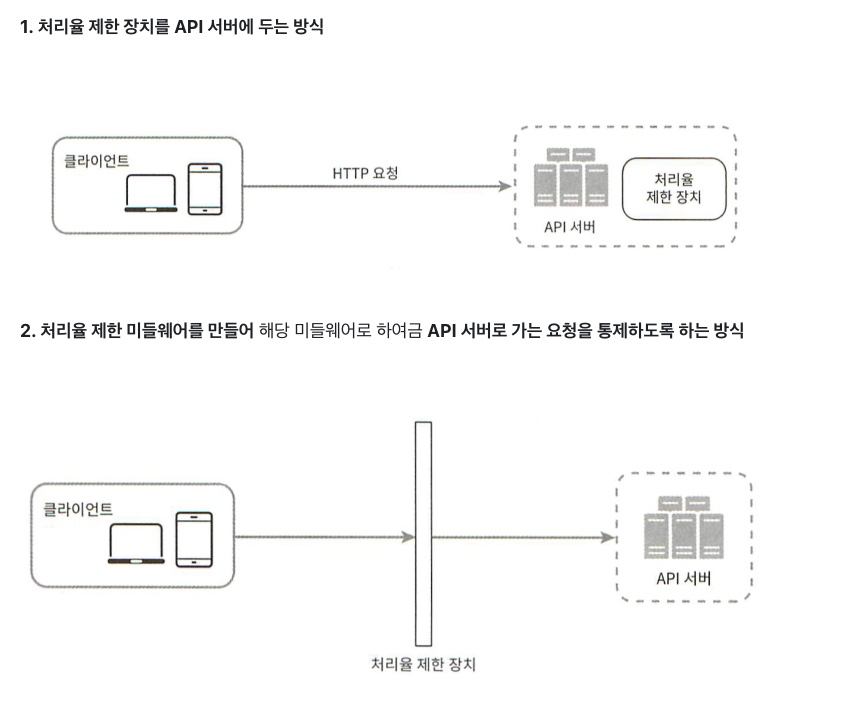

처리율 제한 장치의 제어 위치

- 직관적으로 보자면 처리율 제한 장치는, 클라인트 - 서버 2곳에 위치할 수 있습니다.

→ 처리율 제한장치는 어디에 두는 것이 좋을까?

클라이언트, 서버에 위치해 있을 때 장단점

1) 클라이언트

- 클라이언트의 요청은 쉽게 위변조가 가능하기 때문에, 일반적으로 클라이언트는 처리율 제한을 안정적으로 걸 수 있는 장소가 되지 못합니다.

- 또한, 모든 클라이언트의 구현을 통제하는 것도 어려울 수 있습니다.

2) 서버

- 처리율 장치를 서버쪽에 둔다면, 서버 1곳에서만 관리를 하면 되고, 내부에서만 통제하게 됩니다.

- 처리율 제한 장치를 API 서버에 두는 대신, 미들웨어를 만들어 서버로 오기 전에 통제하는 방법도 존재한다고 합니다.

👏🏻 통상적으로, 트래픽이 너무 많이 몰린경우 HTTP Status Code 는 429 (Too Many Request) 코드번호를 사용합니다.

그래서 처리율 제한 장치는 어디에?

- 처리율 제한 장치의 위치는 처리율 제한 기능을 설계할 때 중요한 요소로, 처리율 제한 장치를 무조건 서버에 혹은 무조건 클라이언트에 두는 것이 정답은 아닙니다.

- 기술 스택이나 엔지니어링 인력, 우선순위, 목표에 따라서 협력적으로 결정하는게 좋다고 합니다.

다만 일반적으로 적용될 수 있는 몇 가지 지침은 다음과 같습니다.

- 프로그래밍 언어, 캐시 서비스 등 현재 사용하고 있는 기술 스택을 고려하라. 현재 사용하는 프로그래밍 언어가 서버 측 구현을 지원하기 충분할 정도로 효율이 높은지 확인하라.

- 사업 필요에 맞는 처리율 제한 알고리즘을 찾아라. 서버 측에서 모든 것을 구현하기로 했다면, 알고리즘은 자유롭게 선택할 수 있다. 하지만 제3 사업자가 제공하는 게이트웨이를 사용하기로 했다면 선택지는 제한될 수 있다.

- 설계가 마이크로서비스에 기반하고 있고, 사용자 인증이나 IP 허용목록 관리 등을 처리하기 위해 API 게이트웨이를 이미 설계에 포함시켰다면 처리율 제한 기능 또한 게이트웨이에 포함시켜야 할 수도 있다.

- 처리율 제한 서비스를 직접 만드는 데는 시간이 든다. 처리율 제한 장치를 구현하기에 충분한 인력이 없다면 상용 API 게이트웨이를 쓰는 것이 바람직한 방법일 것이다.

📌 03. 처리율 제한 알고리즘

널리 알려진 처리율 제한 알고리즘의 종류에는 아래와 같은 것 들이 존재합니다.

1. 토큰 버킷(token bucket)

2. 누출 버킷(leaky bucket)

3. 고정 윈도 카운터(fixed window counter)

4. 이동 윈도 로그(sliding window log)

5. 이동 윈도 카운터(sliding window counter)

1) 토큰 버킷 알고리즘 (Token Bucket)

- 토큰 버킷 알고리즘은 처리율 제한 알고리즘 중 가장 간단하고 보편적으로 사용되는 알고리즘입니다.

- 아마존과 스트라이프가 api 요청을 통제하기위해 이 알고리즘을 사용합니다.

- 통상적으로 API 엔드포인트마다 별도의 버킷을 둡니다.

- IP 주소별로 처리율 제한을 적용해야 한다면 IP 주소마다 버킷을 하나씩 할당해야 한다.

- 시스템의 처리율을 초당 10,000 개 요청으로 제한한다면, 모든 요청이 하나의 버킷을 공유하도록 해야 한다.

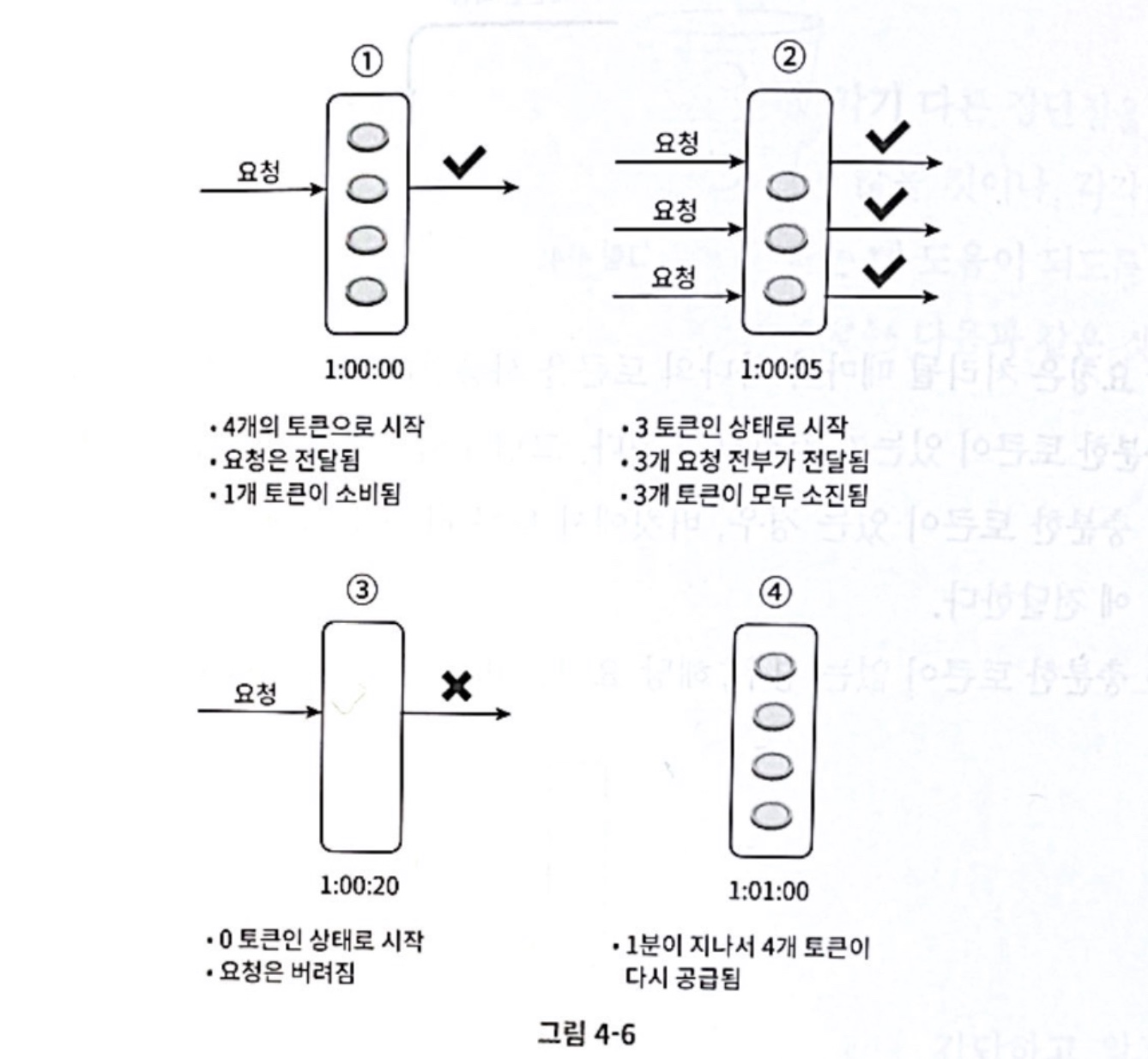

👏🏻 토큰 버킷 알고리즘 이란

- 토큰 버킷은 지정된 용량을 갖는 컨테이너 입니다.

- 이 버킷에는 사전 설정된 양의 토큰이 주기적을 채워집니다.

- 토큰 공급기에 (refiller) 의해 토큰이 꽉차면 더이상 버킷에 토큰이 추가되지 않고, 추가 공급된 토큰은 버려집니다. (overflow)

- 각 요청은 처리될 때마다 하나의 토큰을 사용한다. 요청이 도착하면 버킷에 충분한 토큰이 있는지 검사하게 됩니다.

- 충분한 토큰이 있는 경우, 버킷에서 토큰 하나를 꺼낸 후 요청을 시스템에 전달한다.

- 충분한 토큰이 없는 경우, 해당 요청은 버려진다.

👏🏻 토큰 버킷 알고리즘 장 단점

- 장점

- 구현이 쉽다.

- 메모리 사용 측면에서도 효율적이다.

- 짧은 시간에 집중되는 트래픽도 처리 가능하다. 버킷에 남은 토큰이 있기만 하면 요청은 시스템에 전달될 것이다.

- 단점

- 이 알고리즘은 버킷 크기와 토큰 공급률이라는 두 개의 인자를 가지고 있는데, 이 값을 적절하게 튜닝하는 것이 까다롭다.

🤔 사용자마다 버킷이 부여된다. 만약 더 이상 접속하지 않는 사용자의 경우, 어떻게 처리해야 할까?

리프레시 토큰, 세션(마지막 로그인) 이 오래된 경우, 버킷을 없애버린다.

예) 휴먼계정으로 전환한다.

2) 누출 버킷 알고리즘 (leaky Bucket)

- 누출 버킷 알고리즘은, 토큰 버킷 알고리즘과 유사하지만 `요청 처리율` 이 고정되어 있다는 것 이 다릅니다.

- 누출 버킷 알고리즘은 보통 FIFO 큐로 구현합니다.

👏🏻 누출 버킷 동작과정

- 요청이 도착하면 큐가 가득 차 있는지 살펴본다.

- 빈자리가 있는경우 큐에 요청을 추가한다.

- 큐가 가득차 있으면 새 요청은 버려진다.

- 지정된 시간마다 큐에서 요청을 꺼내어 처리한다.

👏🏻 누출 버킷 알고리즘 장 단점

- 장점

- 큐의 크기가 제한되어 있어 메모리 사용량 측면에서 효과적이다.

- 고정된 처리율을 가지고 있기 때문에 안정적 출력(stable outflow rate)이 필요한 경우에 적합하다.

- 단점

- 단시간에 많은 트래픽이 몰리는 경우 큐에는 오래된 요청들이 쌓이게 되고, 그 요청들을 제때 처리하지 못하면 최신 요청들을 버려지게 된다.

- 토큰 버킷과 마찬가지로, 두 개 인자를 올바르게 튜닝하기 까다로울 수 있다. (버킷 크기 & 처리율)

3) 고정 윈도 카운터 알고리즘 (fixed window counter)

- 설정한 시간당 처리율을 고정시켜 제한하는 방식입니다.

- 예를들어, 초당 3개의 처리만 하겠다고 고정! 이런 것입니다.

👏🏻 고정 윈도 카운터 알고리즘 동작과정

- 타임라인을 고정된 간격의 윈도(window)로 나누고, 각 윈도마다 카운터를 붙인다.

- 요청이 접수될 때마다 이 카운터의 값은 1씩 증가한다.

- 이 카운터의 값이 사전에 설정된 임계치(threshold)에 도달하면 새로운 요청은 새 윈도가 열릴 때까지 버려진다.

→ 그림은 초당(윈도우) 3개의 처리율만 받겠다고 고정한 상태이다. 따라서 각 윈도우에 추가 요청될 경우 버려진다.

👏🏻 고정 윈도 카운터 알고리즘 장 단점

- 장점

- 메모리 효율이 좋다.

- 이해하기 쉽다.

- 윈도가 닫히는 시점에 카운터를 초기화하는 방식은 특정한 트래픽 패턴을 처리하기에 적합하다.

- 단점

- 윈도 경계 부근에서 일시적으로 많은 트래픽이 몰려드는 경우, 기대했던 시스템의 처리 한도보다 많은 양의 요청을 처리하게 된다.

4) 이동 윈도 로깅 알고리즘 (sliding window logging)

- 이동 윈도 로깅 알고리즘은 고정 윈도 카운터의 문제점(윈도 경계 부근에 트래픽이 집중되는 경우 시스템에 설정된 한도보다 많은 요청을 처리하게 되는 것)을 해결하기 위한 알고리즘 입니다.

👏🏻 이동 윈도 로깅 알고리즘 동작과정

- 이 알고리즘은 요청의 타임스탬프(timestamp)를 추적한다. 타임스탬프 데이터는 보통 레디스(Redis)의 정렬 집합 같은 캐시에 보관한다.

- 새 요청이 오면 만료된 타임스탬프는 제거한다. 만료된 타임스탬프는 그 값이 현재 윈도의 시작 시점보다 오래된 타임스탬프를 말한다.

- 새 요청의 타임스탬프를 로그(log)에 추가한다.

- 로그의 크기가 허용치보다 같거나 작으면 요청을 시스템에 전달한다. 그렇지 않은 경우에는 처리를 거부한다.

👏🏻 이동 윈도 로깅 알고리즘 장 단점

- 장점

- 어느 순간의 윈도를 보더라도, 허용되는 요청의 개수는 시스템의 처리율 한도를 넘지 않는다.

- 단점

- 거부된 요청의 타임스탬프도 보관하기 때문에 다량의 메모리를 사용한다.

5) 이동 윈도 카운터 알고리즘 (sliding window counter)

- "고정 윈도 카운터 알고리즘 + 이동 윈도 로깅 알고리즘" 을 결합한 것 입니다.

- 현재 1분간의 요청 수 + 직전 1분간의 요청 수 X 이동 윈도와 직전 1분이 겹치는 비율

👏🏻 이동 윈도 카운터 알고리즘 동작과정

- 이 알고리즘은 요청의 타임스탬프(timestamp)를 추적한다. 타임스탬프 데이터는 보통 레디스(Redis)의 정렬 집합 같은 캐시에 보관한다.

- 새 요청이 오면 만료된 타임스탬프는 제거한다. 만료된 타임스탬프는 그 값이 현재 윈도의 시작 시점보다 오래된 타임스탬프를 말한다.

- 새 요청의 타임스탬프를 로그(log)에 추가한다.

- 로그의 크기가 허용치보다 같거나 작으면 요청을 시스템에 전달한다. 그렇지 않은 경우에는 처리를 거부한다.

👏🏻 이동 윈도 카운터 알고리즘 장 단점

- 장점

- 이전 시간대의 평균 처리율에 따라 현재 윈도의 상태를 계산하므로 짧은 시간에 몰리는 트래픽에도 잘 대응한다.

- 메모리 효율이 좋다.

- 단점

- 직전 시간대에 도착한 요청이 균등하게 분포되어 있다고 가정한 상태에서 추정치를 계산하기 때문에 다소 느슨하다. (심각한 문제는 아니다.)

➡️ 처리율 제한 알고리즘의 기본 아이디어 (근본)

- 기본적으로 처리율 제한 알고리즘은, 얼마나 많은 요청이 접수되었는지를 추적할 수 있는 카운터를 추적 대상별로 두고(사용자별로 추적 할지, IP 주소, API 엔드포인트 등)

- 이 카운터 값이 설정한 한도를 넘어서면, 이 한도를 넘은 후 도착한 요청에 대해 거부하는 것 입니다.

여기서 신경써 봐야할 게, 이 카운터 값을 어디에 저장할 것인지 (캐시 메모리가 좋음) 입니다.

📌 04. 처리율 제한 상세 설계

처리율 제한 규칙

1) 처리율 한도 초과 트래픽 처리

- HTTP 429 응답 (Too many requests): 어떤 요청이 한도 제한에 걸릴때 응답

- 경우에 따라서 한도 제한에 걸린 메시지를 나중에 처리하기 위해 큐에 보관할 수 있다.

2) 처리율 제한 장치가 사용하는 HTTP 헤더

- 클라이언트가 자기 요청이 처리율 제한에 걸리고 있는지에 대한 정보를 아래 HTTP 헤더를 통해 전달한다.

X-Ratelimit-Remaining: 윈도 내에 남은 처리 가능 요청의 수

X-Ratelimit-Limit: 매 윈도마다 클라이언트가 전송할 수 있는 요청의 수

X-Ratelimit-Retry-After: 한도 제한에 걸리지 않으려면 몇 초 뒤에 요청을 다시 보내야 하는지 알림

🤔 헤더 앞에 X가 왜 붙일까?

커스텀한 헤더는 앞에 X를 붙인다. 잘못사용해도 내가 책임안져.

분산 환경에서의 처리율 제한 장치의 구현

여러 대의 서버와 병렬 스레드를 지원하도록 확장한 서비스에서 처리율 제한장치를 설계할 때는 다음 2가지 경우를 고려해야합니다.

- 경쟁조건 (race condition)

- 동기화 (synchronization)

📗 1) 경쟁 조건 (race condition)

처리율 제한장치의 간단한 동작과정

- 레디스에서 카운터의 값을 읽는다.

- counter +1 의 값이 임계치를 넘는지 본다.

- 넘지 않는다면 레디스에 보관된 카운터 값을 1만큼 증가시킨다.

경쟁조건이 일어나는 이유

- 병행성이 심한 환경에서는, 두 개의 요청을 처리하는 스레드가, 하나의 값을 동시에 바꾼다고 하였을 떄 경쟁이 일어날 수 있다.

- 이렇게 되면, 데이터의 정합성이 깨지는 심각한 문제가 발생할 수 있습니다.

경쟁조건 해결 방법

- 가장 보편적인 방법은 락 (이전 글에서 쓴 동시성 처리 방법 예제들 참고하셔도 좋을거같아요)

- 루아 스크립트 (Lua Script)

- 절차지향적 선언형 언어라고 하는데.. 아마 순차적으로 실행시켜서 경쟁을 없앤다는 느낌 같습니다. (아닐지도.. 아는사람??ㅎㅎ)

- 레디스 정렬 집합 (redis sorted set)

- 참고문헌을 보면 sorted set 에 특별한 기능이 있어서 경쟁 이슈를 해결하는 것은 아니였으며, 로직의 문제였다고 합니다.

- 참고 문헌 : https://engineering.classdojo.com/blog/2015/02/06/rolling-rate-limiter/

📗 2) 동기화 (synchronization)

- 분산 서비스 환경에서, 여러대의 처리율 제한 장치를 사용할 경우 요청 또한 분산되기 때문에, 처리율 장치간의 (Counting 값) 동기화가 필요합니다 .

해결 방법

1. 고정 세션 (Sticky session)

- 고정 세션 (Sticky session) 을 사용하여 같은 클라이언트로부터의 요청은 항상 같은 처리율 제한 장치로 보낼 수 있도록 하여 해결할 수 있지만, 확장이 불가하고 유연하지 않기떄문에 추천하지 않는다고 합니다.

2. 중앙 집중형 데이터 저장수

- 레디스와 같은 중앙 집중형 데이터베이스를 사용하는것이 더 나은 해결책이라고 합니다.

📌 05. 이 외에, 처리율 제한장치 설계 시 고려해보면 좋을 것 들

1) 경성 또는 연성 처리율 제한

- 경성 처리율 제한 : 요청의 개수는 임계치를 절대 넘어설 수 없다.

2) 다양한 계층에서의 처리율 제한

- 애플리케이션 계층(7번 계층)에서의 처리율 제한 외에도 다른 계층에서 제어

ex) Iptables를 사용하여 IP 주소에 처리율 제한을 적용

3) 처리율 제한을 회피하는 방법

- 클라이언트 측 캐시를 사용하여 API 호출 횟수 줄이기

- 예외나 에러를 처리하는 코드를 도입하여, 클라이언트가 예외적 상황으로부터 우아하게 복구될 수 있도록 한다.

- 서버가 죽어서 안 되는건지, 요청이 많아서 안 되는 건지 클라에서 알 수 있도록 하자.

- 에러를 받았을 때, 재처리 / 재시도 할 수 있도록 한다. 우아하게 서킷 브레이커 사용하자.

- 서버를 지켜줄 수 있다. 우리 서버 지켜!

- 재시도 로직을 구현할 때는 충분한 백오프 시간을 두도록 한다.

끝!!

휴 특히 힘들었다..

'📗 개발자 책 읽기 > 가상 면접 사례로 배우는 대규모 시스템 설계 기초' 카테고리의 다른 글

| [System Design Interview] 06. ⚙️ 키-값 저장소 (비 관계형 데이터베이스) 설계하기(1) - CAP 이론 정리 (2) | 2023.01.16 |

|---|---|

| [System Design Interview] 05. ⚙️ 안정해시란? (0) | 2023.01.10 |

| [System Design Interview] 03. 시스템 설계 면접 공략법 ❗️ (0) | 2022.12.29 |

| [System Design Interview] 02. 개략적인 규모 측정 (0) | 2022.12.28 |

| [System Design Interview] 01. 사용자 수에 따른 규모 확장성 - 인프라 확장 (0) | 2022.12.19 |